Address

304 North Cardinal St.

Dorchester Center, MA 02124

Work Hours

Monday to Friday: 7AM - 7PM

Weekend: 10AM - 5PM

Address

304 North Cardinal St.

Dorchester Center, MA 02124

Work Hours

Monday to Friday: 7AM - 7PM

Weekend: 10AM - 5PM

Crónica de la jornada celebrada en RED.ES (Madrid) sobre el impacto de la IA en la actividad jurídica y administrativa: garantías, transparencia, responsabilidad y control humano.

Ayer 5 de marzo de 2026 se celebró en Madrid la jornada “Derecho, Inteligencia Artificial y asesoría jurídica de las Comunidades Autónomas” patrocinada por Soltel Group. El evento, que supuso el debut oficial de la Cátedra SOLTEL, logró un pleno institucional al reunir a letrados y responsables de las principales Abogacías Generales de las CCAA, organismos del Estado como el SEPE y la Agencia Tributaria, y expertos académicos de primer nivel.

En la ponencia “Los derechos digitales en el ámbito de la IA”, se planteó una idea potente: la IA ya actúa como infraestructura que condiciona decisiones y acceso a oportunidades (información, crédito, diagnósticos, empleo o incluso contenidos que influyen en la opinión pública).

Desde esa perspectiva, los derechos digitales aparecen como respuesta democrática ante sistemas algorítmicos que pueden afectar derechos fundamentales, especialmente cuando operan como “caja negra”.

También se insistió en principios clave como:

En el plano normativo, se repasó el impulso regulatorio europeo (Reglamento UE 2024/1689) y su calendario de aplicación, con un enfoque basado en niveles de riesgo.

La intervención sobre responsabilidad patrimonial e IA en sanidad situó el debate donde más importa: la intersección entre tecnología y integridad física, donde la responsabilidad pública entra en una fase de transformación.

Entre los puntos más relevantes:

Se subrayó que, si la IA mejora significativamente precisión diagnóstica o reduce errores, su uso puede acabar integrándose en la lex artis. En ese escenario, no usar una IA validada cuando los protocolos lo sugieren podría considerarse falta de diligencia.

A la vez, aumenta el deber de supervisión: confiar “a ciegas” en la IA o rechazar sin justificación una recomendación correcta puede generar responsabilidad si causa daño.

El “efecto caja negra” complica probar cómo un sistema llegó a una conclusión errónea, lo que puede traducirse en indefensión.

De ahí la importancia de la explicabilidad y de comunicar factores determinantes de la decisión de forma comprensible (no solo “código fuente para técnicos”).

Se propuso una tipología útil para entender la imputación del daño:

Y se abordó la convergencia con el régimen de productos defectuosos (Directiva UE 2024/2853), incluyendo la posibilidad de acción de repetición de la Administración frente al fabricante tras indemnizar.

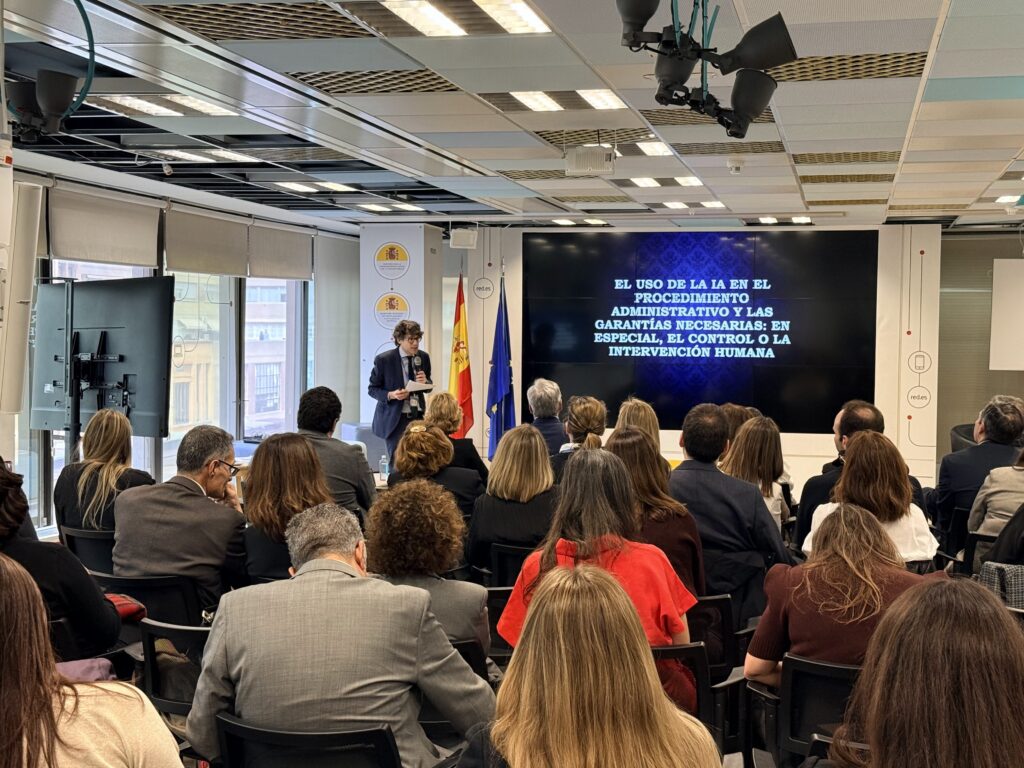

La ponencia “El uso de la IA en el procedimiento administrativo y las garantías necesarias: en especial, el control o la intervención humana” puso el foco en la idea del procedimiento como garantía y en cómo “conciliar instituciones tradicionales con la innovación”.

Entre los mensajes principales:

Conclusión práctica: aprovechar las ventajas de la IA exige reforzar cautelas y, especialmente, una supervisión humana efectiva.

Frente a los retos teóricos, la jornada aterrizó en la realidad de los gabinetes jurídicos: la gestión de grandes volúmenes de expedientes. Se presentó a ELEX como la solución diseñada para absorber esa carga masiva de trabajo sin perder el control humano.

Se destacó cómo su arquitectura de microservicios y su alineamiento con el ENS categoría ALTA permiten automatizar tareas críticas (plazos, alertas, integración con Lexnet) asegurando que el letrado mantenga siempre la supervisión significativa que exige el nuevo marco de la IA.

La jornada dejó una idea transversal: en el sector público la tecnología solo es progreso si es gobernable y capaz de responder a la volumetría real. En Sistema ELEX nos reafirmamos en nuestro compromiso: ofrecer una herramienta robusta que convierta los retos de la IA en eficiencia diaria para los profesionales del Derecho Público

Este blog solo recoge una muestra resumida del contenido que puedes encontrar en este número de la Revista Digital «ELEX INSIGHT«. Para acceder a todos los números de forma gratuita, visita el siguiente enlace:

🡡 Haz clic para leer 🡡

Si deseas descubrir cómo la inteligencia artificial de ELEX puede transformar tu práctica legal, solicita ahora una DEMO a través de este enlace o programa una reunión con nuestros expertos para aclarar cualquier duda que puedas tener al respecto.

[…] el marco de la jornada, se presentó a ELEX como el exponente práctico de esta filosofía. En un contexto de alta carga administrativa, […]